北师大举行大模型应用中未成年人保护和发展跨学科研讨会

发布日期:2023-04-22浏览次数:

2023年4月20日,“大模型应用中未成年人保护和发展评估——以ChatGPT、文心一言等生成式人工智能为例”跨学科研讨会在京师大厦举行。研讨会由北京师范大学新闻传播学院主办。来自中国社会科学院、中国青少年研究中心、对外经济贸易大学、北京互联网法院及北师大新闻传播学院、教育学部、法学院专家学者参会,共同探讨ChatGPT、文心一言等人工智能大模型对未成年人保护和发展的影响。

新闻传播学院院长张洪忠主持会议。

一、大语言模型上未来AGI发展拥有无限可能

哈尔滨工业大学计算机学院教授车万翔做了主题为“ChatGPT浅析”的引导发言,重点介绍了自然语言的特点及难点。他指出,自然语言被誉为“人工智能皇冠上的明珠”,将是制约人工智能取得更大突破、更广泛应用的瓶颈。车万翔梳理了自然语言处理技术五次范式变迁,指出ChatGPT是大规模预训练语言模型的代表,是继数据库和搜索引擎之后的全新一代“知识表示和调用方式”,引领着人工智能行业的发展。同时他表示,预训练语言模型并不能真正克服现有深度学习模型鲁棒性差、可解释性弱、推理能力缺失的瓶颈,在深层次语义理解上与人类认知水平还相去较远,由此提出弥补大模型不足的方向和建议。他指出,AGI的实现需要在大语言模型基础之上,结合多模态和具身智能。最后,重点展望了大语言模型上未来AGI发展的无限可能。

二、生成式人工智能背景下青少年保护与发展

主旨发言阶段,中国社会科学院新闻与传播研究所教授卜卫做了“ChatGPT给青少年带来的机遇与挑战”主旨发言。她认为ChatGPT为青少年提供了教育、交流、娱乐、生活技能社会学习等资源机遇,同时带来信息泄露、不良内容、时间管理、安全风险、恶意软件和病毒等风险,常用的四大互联网治理术:立法和发展政策、社会压力集团、媒介自律、媒介素养教育都随着技术发展变化而变化,ChatGPT时代我们更应该关注青少年数字素养中的沟通与协作素养,即通过数据技术互动、分享和合作的能力以及青少年又会如何影响GPT传播技术内容形式和发展。

中国青少年研究中心青少年法律研究所所长郭开元指出青少年的价值观并不成熟,容易受到外界的影响。如果教育应用过度依赖人工智能并代替老师,情感教育将会丧失。大模型应用对未成年人的保护不仅需要靠法律的支撑,还要基于儿童权益最大化的视角去设置规则。

教育部义务教育课程标准信息科技组组长,对外经贸大学信息学院院长熊璋做了“AI大模型时代的未成年人教育”主旨报告。他认为AI大模型时代的未成年人教育三大改变:一是从量到质的改变,二是从表及里的改变,三是从缓至激的改变,提出对AI大模型时代的未成年人教育三个认识:保护和发展的基础是教育,教育的基础是基础教育,基础教育的基础是素质教育。

中国政法大学未成年人事务治理与法律研究基地副主任苑宁宁分析了在人工智能发展背景下儿童安全与权益的平衡关系,生成式人工智能对未成年人的学习权和受教育权带来了革命性变化,实现了全天候的互动学习。未来在技术研发中要重视儿童伦理建设,将未成年人的伦理教育前置,要打造“家长工具”,研发者需要设计“主动性技术”,配套针对未成年人的防范性措施。

北京师范大学互联网教育技术及应用国家工程研究中心常务副主任郑勤华做了“AIGC的教育影响”报告,他具体阐释了21世纪人才培养目标、中国学生发展核心素养和面向学生全面发展的未来教育,提出目前AI存在的关键性难题和着重发力点。他指出目前AIGC还是弱人工智能,给人类的创新未来带来了无限可能。

北京市未来教育高精尖创新中心人工智能实验室主任卢宇做了“生成式人工智能的教育应用展望”报告,他指出基于启发性内容生成、对话情境理解、序列任务执行、程序语言解析四项核心能力,ChatGPT在教师教学、学习过程、教育评价、学业辅导等多个典型教育环节,可以支撑多项潜在教育应用。他以“多模态汉字学习系统”为例,展望未来生成式人工智能的教育应用,从多方面指出目前生成式人工智能存在的局限与潜在风险。

北京互联网法院少年庭庭长孙铭溪重点介绍了当前人工智能典型判例,阐述了当前自动化决策仍是较浅层的应用,在司法过程中算法的解释、应用等等依然存在较大的问题,她表示,人工智能领域空间治理和未成年人网络保护需要多方协作。

中国互联网协会研究中心副主任、北京师范大学法学院教授吴沈括指出,人工智能给教育方式和社会治理带来巨大的变化,技术的使用在新生代已经不可避免,要以引导的方式更好获益。他表示,科技向善是我们对人工智能价值追求。他就人工智能网络治理方式的价值指向和未成年人网络保护机制设计发表见解。

北京师范大学新闻传播学院副教授刘茜带来“人工智能创新与伦理——AI时代的青少年网络隐私风险与保护”报告。她介绍了智能互联网媒体时代互联网媒体的演变,指出青少年网络隐私风险来源基于青少年主体、技术、机构、他人,表示要加强青少年隐私教育和法律法规建设,提高青少年隐私风险保护意识和知识,在动态发展中持续协同保护青少年权益。

三、北师大发布首个生成式人工智能未成年人保护和发展指标体系

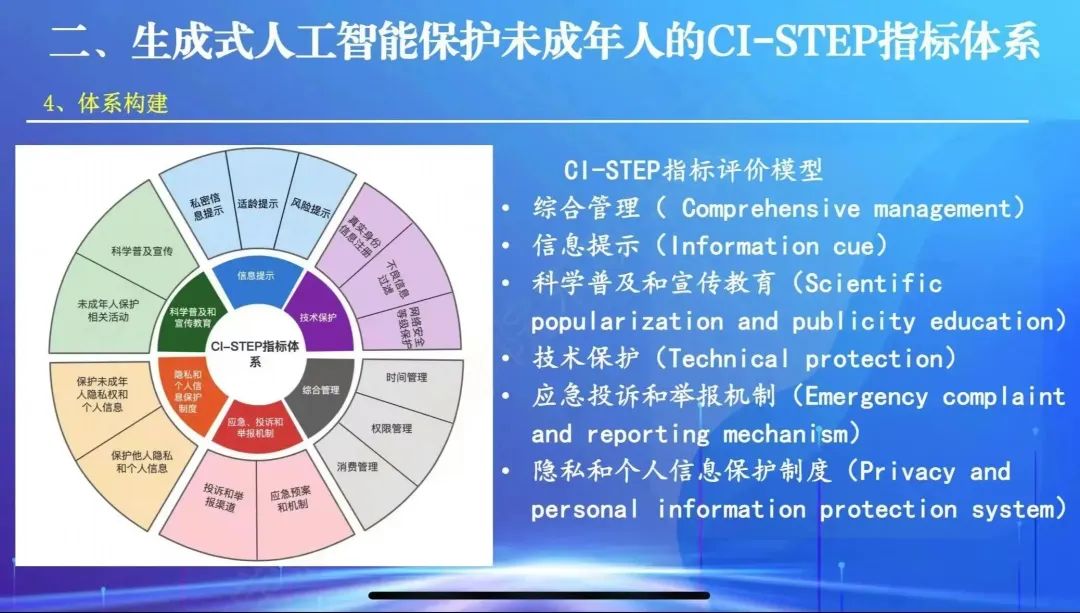

北京师范大学新闻传播学院党委书记、未成年人网络素养研究中心主任方增泉发布全国首个生成式人工智能未成年人保护和发展评估指标体系——CI-STEP指标评价模型。该指标体系根据皮亚杰儿童智力发展阶段性理论、科尔伯格道德发展阶段论等理论,结合联合国儿基会、联合国教科文组织和我国相关政策依据,研发构建了CI-STEP指标评价模型。

该模型具体包括综合管理( Comprehensive management)、信息提示(Information cue)、科学普及和宣传教育(Scientific popularization and publicity education)、技术保护(Technical protection)、应急投诉和举报机制(Emergency complaint and reporting mechanism)、隐私和个人信息保护制度(Privacy and personal information protection system)6个维度。

方增泉认为,生成式人工智能未成年人保护和发展在未来需要落实技术标准、重点关注风险、明确评估义务。在技术向善理念的指导下,技术发展应当坚持最有利于未成年人的原则,提出兼顾未成年人网络安全和数字发展、注重AI技术应用符合科技伦理、鼓励互联网企业积极参与行业共治的总体原则。在“儿童为中心”“保护儿童权利”“承担责任”和“多方治理”理念的指导下,呼吁社会各界高度重视人工智能对未成年人的影响,人工智能的发展应保护和促进未成年人的权益,避免剥夺和损害未成年的权利,助力实现未成年人健康成长。

新闻传播学院院长张洪忠进行总结发言,他指出通过跨学科研讨,深刻讨论了未成年教育领域大语言模型应用存在的问题和可能产生的影响,指出大模型应用对未成年人保护和发展仍需经过不断的深入研究,ChatGPT等生成式人工智能未来的发展状况仍需不断地进行评估和反思以实现对未成年人的全面保护和赋能发展。

分享到微博

分享到微博 分享到微信

分享到微信

京ICP备13009620号

京ICP备13009620号